L’Uso dell’IA negli atenei italiani

12

Anni di esperienza

6.000+

Studenti aiutati

24/7

Supporto attivo

100%

Privacy Garantita

Fino a pochi anni fa, parlare di intelligenza artificiale all’università significava discutere tesi teoriche, algoritmi futuristici o scenari etici. Oggi, la realtà è molto più concreta: gli studenti italiani utilizzano quotidianamente l’intelligenza artificiale per cercare idee, riformulare testi, generare interi paragrafi.

In questo nuovo contesto, l’università italiana si trova a rincorrere un cambiamento che è già avvenuto. Da un lato, l’IA offre vantaggi evidenti: velocizza la scrittura, chiarisce concetti, migliora lo stile. Dall’altro, genera incertezza. Cosa è ancora considerato “autonomo”? Qual è il confine tra supporto e scorciatoia?

Per cercare risposte, a giugno del 2025 Team CETU ha condotto un sondaggio anonimo su un campione di 507 studenti universitari italiani, iscritti a corsi di laurea triennale, magistrale e dottorato. A questo si affiancano le analisi condotte da Team Cetu, in partnership con uno dei più potenti software antiplagio e anti AI ovvero Plagioscanner.com, analizzando i risultati di oltre 21.000 elaborati accademici verificati tra aprile 2024 e giugno 2025.

I risultati non lasciano spazio a dubbi: l’intelligenza artificiale è diventata parte integrante dell’esperienza accademica, ma il quadro che emerge è tutt’altro che lineare.

Oltre l’80% degli studenti italiani usa l’intelligenza artificiale per i lavori accademici

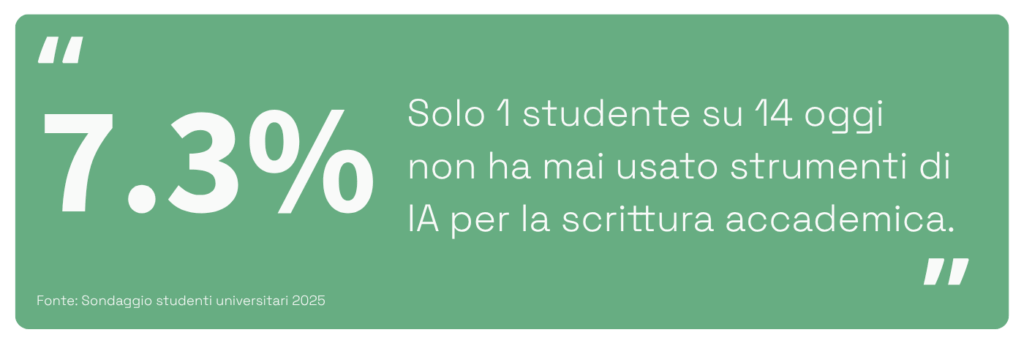

L’uso dell’intelligenza artificiale da parte degli studenti universitari italiani non è più un fenomeno marginale. È una realtà diffusa, trasversale, normalizzata. Secondo i dati raccolti, l’83% degli studenti ha già utilizzato almeno una volta strumenti di intelligenza artificiale generativa. Tra questi, quasi la metà (49%) lo fa con regolarità. Solo una piccola minoranza (il 7%) afferma di non averli mai utilizzati, mentre un ulteriore 3% sta valutando di farlo.

Il dato che colpisce non è soltanto la portata, ma la velocità con cui l’IA è stata assorbita nel quotidiano accademico. Senza regolamenti chiari e senza un vero dibattito pubblico, si è aperto un nuovo fronte educativo di cui pochi sembrano avere pieno controllo.

Dottorandi al primo posto nell’uso accademico

L’uso dell’IA cresce in modo proporzionale al livello accademico. I dottorandi risultano i più inclini a integrarla nel proprio lavoro (87%), seguiti dagli studenti di laurea magistrale (84%) e da quelli triennali (83%).

Questo ribalta lo stereotipo che l’IA sia uno strumento da “principianti” o da chi fatica a scrivere. Anzi, i dati suggeriscono che proprio gli studenti più avanzati siano gli utilizzatori più assidui.

Le facoltà più coinvolte

Non tutte le aree di studio affrontano l’intelligenza artificiale allo stesso modo. Secondo il nostro sondaggio, gli studenti di Economia e Giurisprudenza sono quelli che la utilizzano di più (85%), mentre le percentuali scendono leggermente tra gli iscritti a facoltà di Lettere (79%).

A confermare e ampliare questo quadro arrivano anche i dati del database proprietario CETU: le facoltà con la percentuale più alta di contenuto IA rilevato nei testi analizzati sono Biologia, Scienze Giuridiche e Psicologia.

Tra i corsi di laurea con più alta percentuale di AI rilevata figurano Psicologia magistrale, Scienze Motorie e Biotecnologie. Una varietà che suggerisce come l’intelligenza artificiale venga adottata in modi diversi a seconda della pressione accademica o della natura dei testi richiesti.

Per due terzi degli studenti, l’IA è un aiuto per comprensione

Nonostante i timori, quasi due terzi degli studenti (65%) dichiarano che l’IA li ha aiutati a comprendere meglio gli argomenti studiati. Solo il 9% afferma di aver compreso meno grazie all’uso di questi strumenti, mentre il 17% non ha notato differenze significative.

La percezione positiva è maggiore fra gli studenti di Medicina, con l’81% che associa l’IA a un miglioramento dell’apprendimento.

Eppure, dietro questi numeri si nasconde una domanda scomoda: migliorare la comprensione è lo stesso che migliorare le competenze?

I limiti e le problematiche poste dall’IA nel mondo accademico

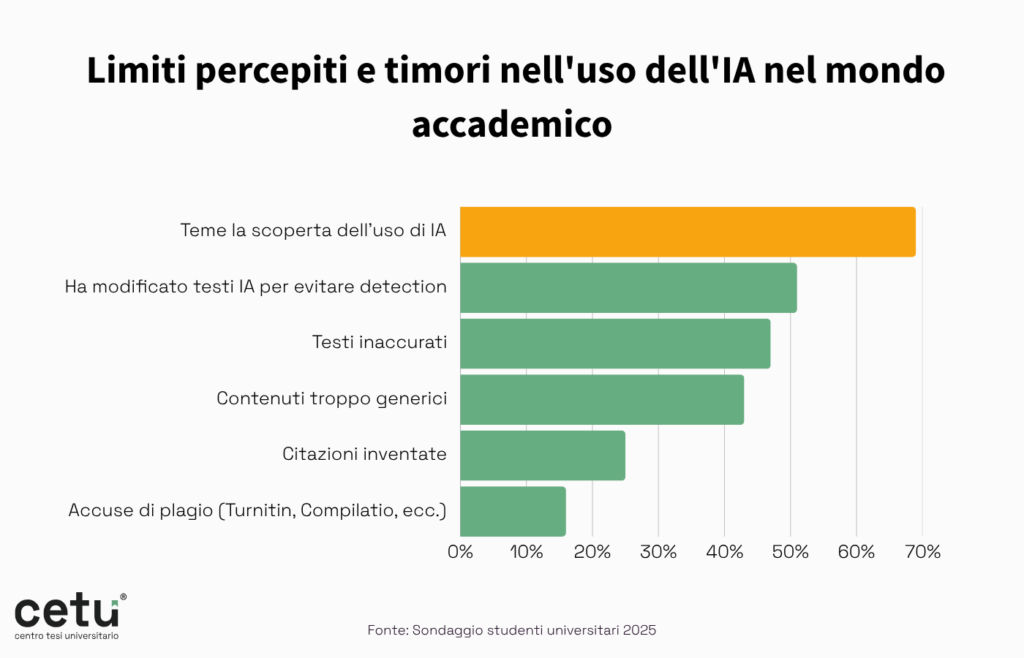

Se da un lato l’intelligenza artificiale viene percepita come un aiuto concreto allo studio, dall’altro molti studenti iniziano a vederne i limiti. Quasi la metà degli studenti intervistati (47%) ha riscontrato problemi di accuratezza nei testi generati. Un altro 43% li ha trovati troppo generici.

Le citazioni che non esistono

Uno degli errori più gravi segnalati è la generazione di riferimenti inventati: il 25% degli studenti ha individuato citazioni inesistenti nei testi prodotti con strumenti di IA. Un problema particolarmente critico per chi lavora su tesi, articoli o relazioni dove la bibliografia e le citazioni non sono dettagli, ma requisiti fondamentali.

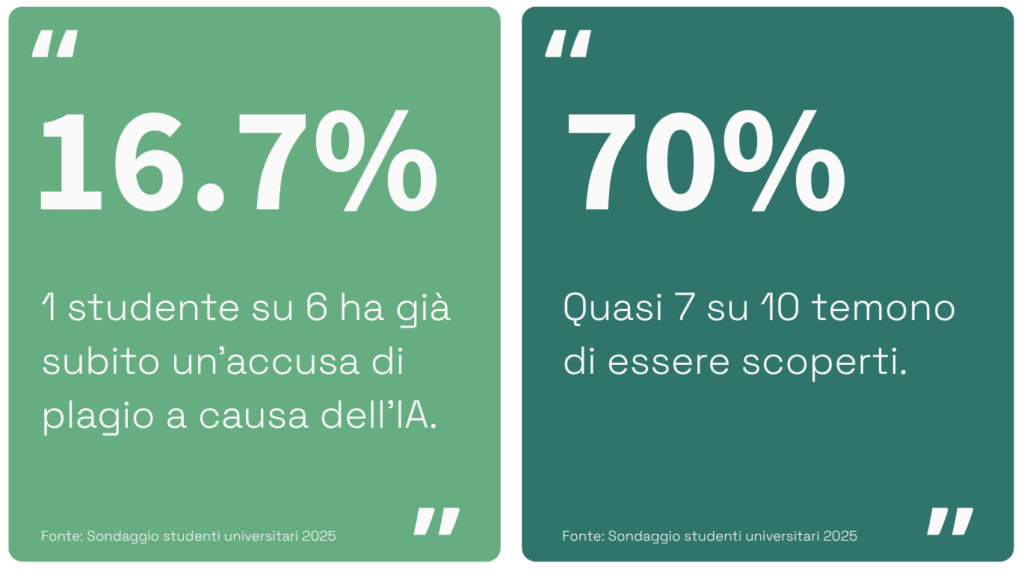

L’ombra del plagio

Nel 16% dei casi, l’uso dell’intelligenza artificiale ha portato ad accuse dirette di plagio, spesso rilevate da software come Turnitin o simili.

Per evitare problemi con i software antiplagio, molti studenti modificano attivamente i testi generati dall’IA. Lo fa il 51%, soprattutto in ambiti dove la sensibilità linguistica è più marcata: Scienze Sociali (65%) e Lettere/Arti (56%) guidano la classifica.

Al contrario, chi studia Medicina (47%) o STEM (44%) tende a modificare meno.

Un clima di ansia

Il 69% degli studenti dichiara di avere paura che l’uso dell’IA venga scoperto. Per molti è una preoccupazione marginale, ma più di 1 su 4 (28%) si dice molto preoccupato. Solo il 26% afferma di non essere affatto in ansia.

Non si tratta solo di paura di sanzioni, ma anche di incertezza su cosa sia effettivamente permesso.

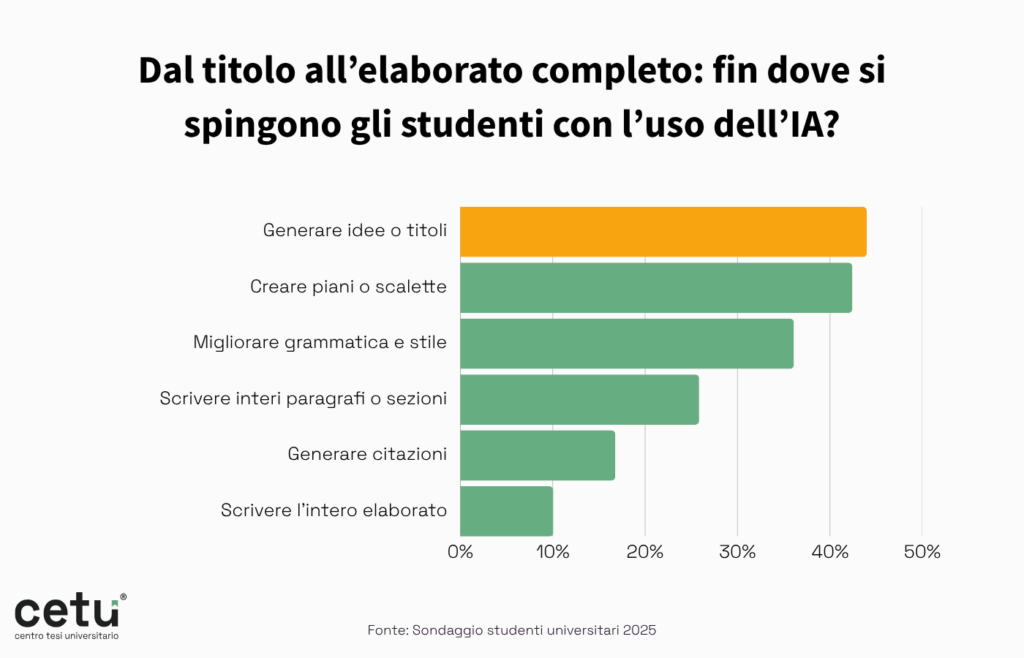

Uno studente su tre usa l’IA per scrivere interamente i propri elaborati

Uno su 10 studenti ha consegnato un intero scritto senza contributi manuali

Il 26% degli studenti dichiara di aver usato l’intelligenza artificiale per scrivere interi paragrafi o sezioni di testo. Il 17% si è spinto oltre, chiedendo all’IA di generare citazioni accademiche. E, soprattutto, il 10% ammette di aver completato un intero elaborato con l’IA, senza contributo manuale.

Si tratta di numeri ridotti rispetto all’uso generale, ma non trascurabili.

Medicina, il caso più sorprendente

Secondo i dati del sondaggio, gli studenti di Medicina risultano i più propensi ad affidarsi completamente all’IA per la stesura dei testi: il 13% di loro ha dichiarato di aver consegnato un testo scritto interamente dall’IA. Una percentuale superiore alla media, in un ambito che richiede rigore, fonti affidabili e attenzione al dettaglio.

Una delega invisibile

Dopo aver visto quanto si usano questi strumenti, resta da capire: cosa succede quando si affidano interi testi (o tesi) a un algoritmo? Il dato più preoccupante non è soltanto nella quantità, ma nella trasparenza. In molti casi, l’uso dell’IA non viene discusso, regolato o nemmeno cercato. Gli elaborati vengono letti, valutati e approvati senza passare da strumenti di verifica adeguati, o senza che i docenti abbiano ricevuto indicazioni su come interpretarli.

Secondo i dati CETU, tra aprile 2024 e giugno 2025, nei testi caricati sul portale è stata rilevata una percentuale media di contenuto generato da IA pari al 18%. E in 177 casi (circa l’1%), oltre il 90% del testo risultava scritto da un’intelligenza artificiale.

Numeri ancora contenuti, ma che confermano un trend latente: in alcuni casi, l’IA non è un supporto. È l’autore principale.

Consegnare senza leggere: quando lo studente si affida ciecamente all’IA

C’è una linea sottile tra usare uno strumento e lasciarsi guidare da esso. I dati raccolti mostrano che molti studenti, dopo aver sperimentato l’intelligenza artificiale per scrivere testi accademici, finiscono per delegare anche l’ultima fase: la revisione.

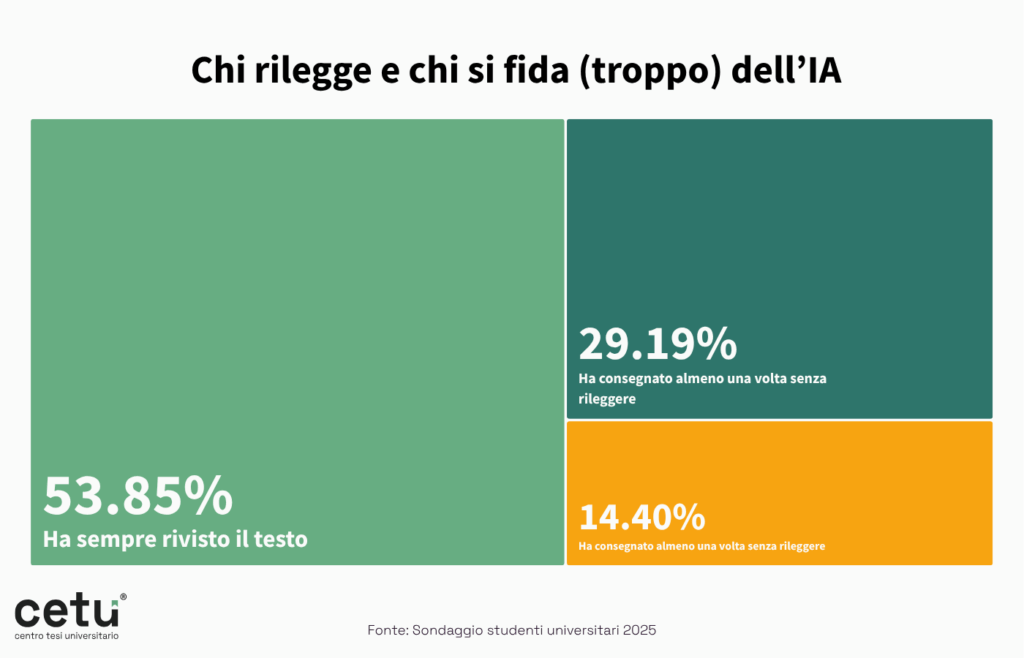

Secondo l’indagine, quasi 1 studente su 3 (29%) ha consegnato almeno una volta un testo generato da IA senza leggerlo o modificarlo. Ma c’è di più: il 14% dichiara di averlo fatto più volte.

Quasi il 30% degli studenti ha consegnato almeno una volta un elaborato scritto con l’IA senza rileggerlo

La maggioranza degli studenti (54%) afferma di aver sempre rivisto ciò che l’IA ha prodotto prima di consegnarlo. Ma questo dato, preso da solo, può trarre in inganno. Perché l’altra metà si divide tra chi non rilegge occasionalmente e chi ha ormai normalizzato questa pratica.

La maggioranza degli studenti (54%) afferma di aver sempre rivisto ciò che l’IA ha prodotto prima di consegnarlo. Ma questo dato, preso da solo, può trarre in inganno. Perché l’altra metà si divide tra chi non rilegge occasionalmente e chi ha ormai normalizzato questa pratica.

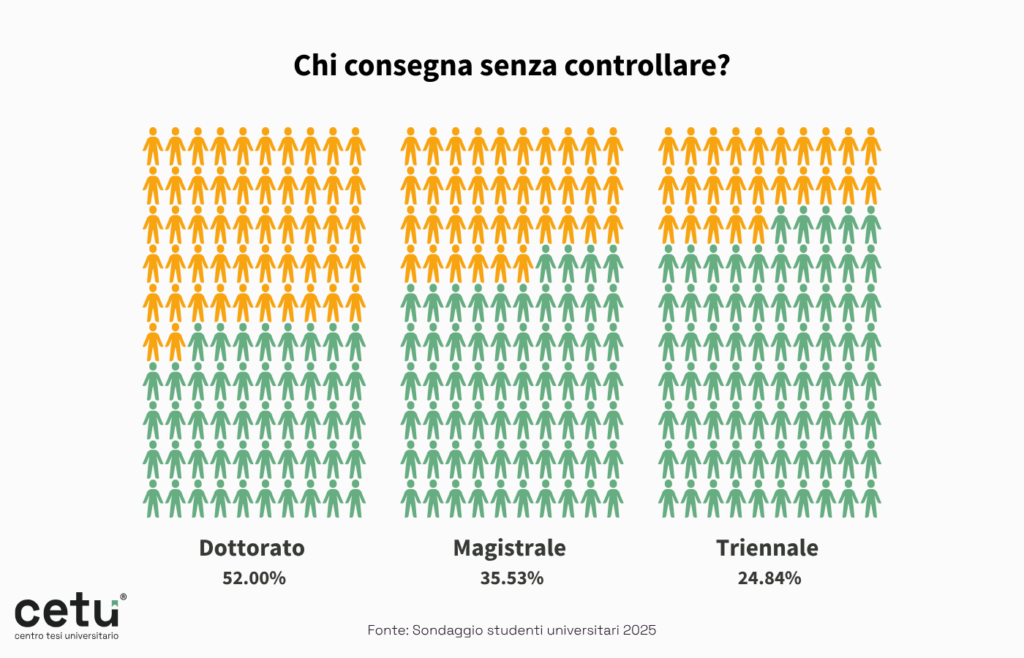

I più esperti, i meno attenti

Sorprendentemente, i dottorandi sono la categoria più incline a consegnare testi generati dall’IA senza controllo: il 52% ammette di averlo fatto. Seguono gli studenti magistrali (36%) e quelli triennali (25%).

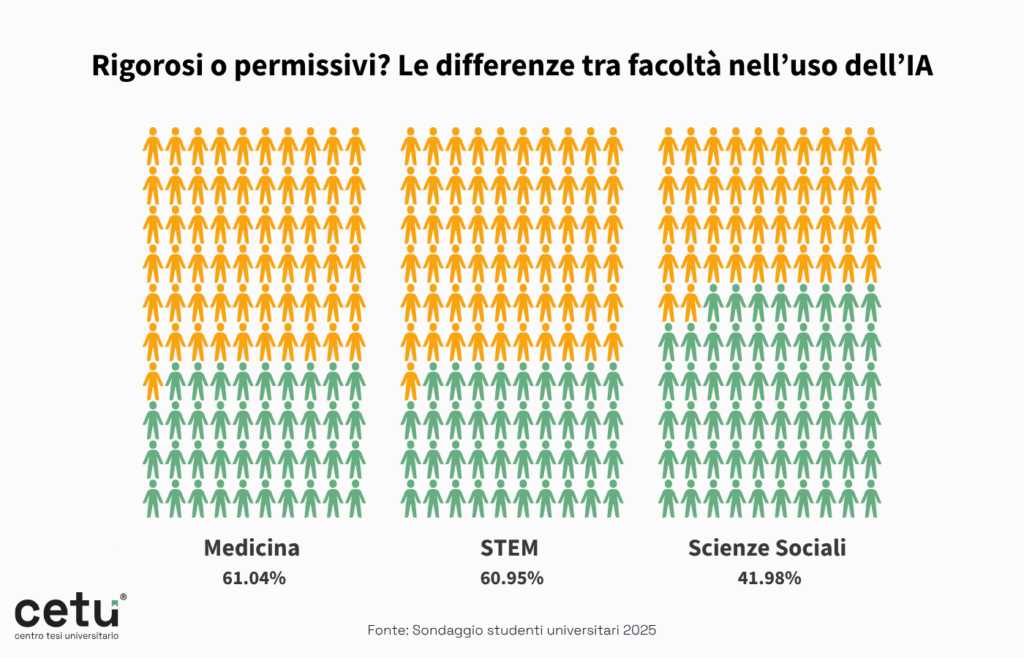

Le differenze tra facoltà

Le differenze emergono anche tra aree disciplinari. Gli studenti di Medicina e STEM (61%) sono i più diligenti: revisionano quasi sempre ciò che l’IA produce.

All’estremo opposto troviamo gli studenti di Scienze Sociali, dove solo il 42% dichiara di rivedere sistematicamente i testi.

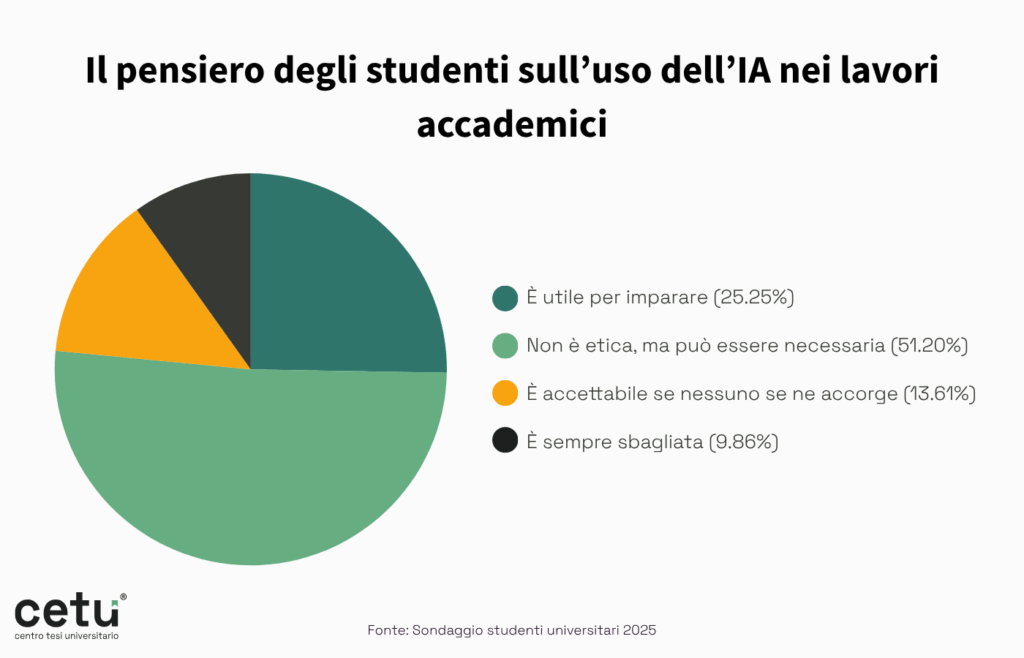

Per 1 su 7 studenti, l’IA va bene finché non ti scoprono

Fino a che punto è accettabile usare l’intelligenza artificiale per un lavoro accademico? La risposta non è univoca. E per una parte significativa degli studenti, non dipende tanto dal principio, quanto dalla possibilità di essere scoperti.

Secondo i dati raccolti, il 14% degli studenti considera l’uso dell’IA accettabile se nessuno se ne accorge.

Tra utilità e dilemma morale

Le opinioni restano frammentate. Il 25% degli intervistati ritiene che l’IA sia uno strumento utile per apprendere. Quasi il 51% ammette che, pur non essendo etica, possa essere necessaria in certe situazioni. Solo il 10% mantiene una posizione netta: per loro, usare l’IA è sempre sbagliato.

Se da un lato l’intelligenza artificiale si sta facendo spazio tra le abitudini quotidiane degli studenti, dall’altro le istituzioni accademiche sembrano muoversi con maggiore incertezza. I docenti ne sono consapevoli, ma le università faticano a offrire strumenti chiari per affrontare una trasformazione già in corso.

Secondo il sondaggio, l’89% degli studenti crede che i professori siano in grado di riconoscere testi scritti con l’IA. Ma quasi la metà (il 48%) ritiene di sapere più cose sull’IA rispetto ai propri docenti.

Una percezione che, vera o falsa che sia, segnala uno squilibrio di controllo: chi valuta non sempre ha gli strumenti per capire come sono stati scritti i testi che corregge.

Le università conoscono l’IA. Ma non sanno ancora come gestirla

Linee guida: poche, vaghe o confuse

La situazione è chiara nei numeri: solo il 18% degli studenti dichiara di aver ricevuto istruzioni precise sull’uso dell’IA nei lavori universitari.

La maggioranza parla di linee guida vaghe o assenti (42%) o insufficienti (28%). Una minoranza che lascia il campo aperto a interpretazioni soggettive o soluzioni improvvisate.

Il risultato è un vuoto regolamentare in cui l’uso dell’IA non è né incoraggiato né vietato ma semplicemente non gestito.

Dove manca il supporto

Le differenze si riflettono anche tra le aree di studio. Gli studenti di Scienze Sociali (30%) ed Economia/Giurisprudenza (23%) sono quelli che ricevono maggior supporto in merito all’uso dell’IA.

All’opposto troviamo la Medicina, dove solo il 13% riferisce di aver avuto indicazioni chiare. Una distanza che si accentua se si considera quanto le discipline scientifiche siano esposte al rischio di informazioni errate o fonti non verificabili.

La regolamentazione? In ritardo

Alla domanda diretta sulla prontezza dell’università italiana nel gestire l’uso dell’IA, la risposta è netta: il 55% degli studenti ritiene che gli atenei siano in ritardo. E non tutte le università reagiscono allo stesso modo. Secondo i dati CETU, tra quelle con maggiore incidenza di contenuto IA rilevato ci sono gli atenei telematici. Un dato che apre interrogativi sul ruolo delle modalità didattiche, sull’interazione diretta con i docenti e sul livello di controllo effettivo.

I corsi più critici? STEM e Medicina, quelli che per paradosso richiederebbero maggiore precisione e rigore.

L’università è consapevole dell’uso crescente dell’IA, ma spesso resta senza strumenti per gestirlo. In molti corsi, l’assenza di regole non è solo una lacuna: diventa una zona grigia che costringe a scelte individuali, spesso in solitudine, con effetti diretti su valutazioni, equità e responsabilità.

Conclusioni: un cambiamento già in corso, ma ancora senza direzione

L’intelligenza artificiale è entrata nell’università italiana senza preavviso, ma con effetti profondi. La stragrande maggioranza degli studenti la utilizza, spesso senza indicazioni chiare, né dalla propria facoltà né dai propri docenti.

Tra chi la adopera per imparare e chi la delega completamente alla scrittura, il risultato è una trasformazione profonda del modo in cui si produce e si valuta il sapere accademico. Ma con questa trasformazione cresce anche l’ambiguità: cosa è accettabile? Dove si traccia il confine tra supporto e sostituzione? Chi garantisce l’equità nelle valutazioni?

Se oggi l’uso dell’IA è una realtà quotidiana, la mancanza di riferimenti concreti lascia molti studenti a gestirla da soli. In questo contesto, il bisogno di accompagnamento — competente, etico, trasparente — non è solo un’opzione. È una condizione necessaria per restituire fiducia a un sistema che rischia di perdere il controllo sulla sua funzione più essenziale: formare, non solo valutare.